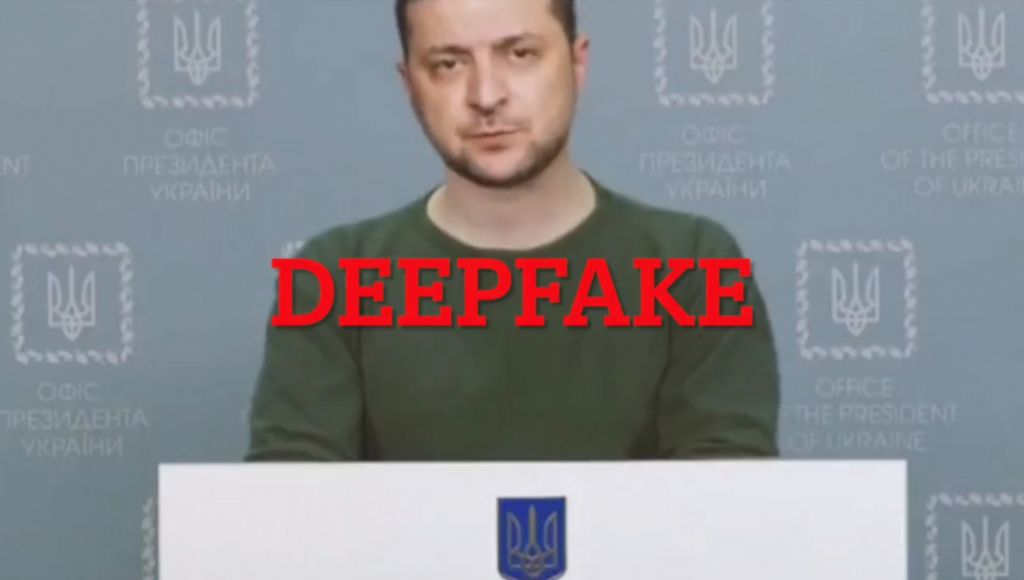

Ένα μάλλον κακοφτιαγμένο βίντεο που υποτίθεται δείχνει τον ουκρανό πρόεδρο Βολοντίμιρ Ζελένσκι να υποχωρεί στις απαιτήσεις της Ρωσίας κυκλοφόρησε ευρέως στο Διαδίκτυο, έγινε όμως αντικείμενο χλευασμού.

Ειδικοί προειδοποιούν πάντως ότι η τεχνολογία deepfake μπορεί να χρησιμοποιηθεί για πιο πειστική προπαγάνδα εν μέσω της ρωσικής εισβολής στην Ουκρανία.

Το άγνωστης προέλευσης βίντεο εμφανίζει έναν χλωμό Ζελένσκι να μιλά από το προεδρικό μέγαρο και να καλεί τους Ουκρανούς να παραδώσουν τα όπλα.

A deepfake of Ukrainian President Volodymyr Zelensky calling on his soldiers to lay down their weapons was reportedly uploaded to a hacked Ukrainian news website today, per @Shayan86 pic.twitter.com/tXLrYECGY4

— Mikael Thalen (@MikaelThalen) March 16, 2022

Χρήστες του Διαδικτύου έσπευσαν να παρατηρήσουν ότι το χρώμα του δέρματος είναι διαφορετικό στο λαιμό και το πρόσωπο, η προφορά ακούγεται περίεργη και το κεφάλι δείχνει να έχει υποστεί επεξεργασία.

Στέλεχος του Facebook δήλωσε ότι το βίντεο απομακρύνθηκε από την πλατφόρμα.

Τα deepfake είναι πλαστά βίντεο που δημιουργούνται από αλγόριθμους τεχνητής νοημοσύνης και εμφανίζουν τους εικονιζόμενους να κάνουν ή να λένε πράγματα που δεν συνέβησαν ποτέ.

Η Νίνα Σικ, συγγραφέας του βιβλίου Deepfakes, περιέγραψε το τελευταίο βίντεο ως «απολύτως απαίσιο facewap», αναφερόμενη σε μια από τις απλούστερες τεχνικές deepfake, στην οποία το πρόσωπο προστίθεται σε ξένο σώμα.

Το βίντεο δείχνει να συνδέεται με την υποτιθέμενη δήλωση συνθηκολόγησης του Ζελένσκι που εμφανίστηκε για λίγο ως κυλιόμενο κείμενο στη μετάδοση του τηλεοπτικού σταθμού Ukraine24, ο οποίος απέδωσε το περιστατικό σε χάκερ.

Το ίδιο το βίντεο εμφανίστηκε για λίγο στον ιστότοπο του καναλιού, το οποίο έσπευσε να διευκρινίσει στο Facebook πως η ανάρτηση είναι «fake» και έργο «χάκερ του εχθρού».

Το ουκρανικό υπουργείο Άμυνας ανάρτησε από την πλευρά του βίντεο του πραγματικού Ζελένσκι που έκανε λόγο για «παιδιάστική προβοκάτσια».

🔊 «Ми вдома і захищаємо Україну. Ніякої зброї ми складати не збираємось. До нашої перемоги», – Президент України @ZelenskyyUa pic.twitter.com/IkfDxLzqne

— Defence of Ukraine (@DefenceU) March 16, 2022

Πριν από δύο εβδομάδες, η στρατιωτική υπηρεσία πληροφοριών της Ουκρανίας προειδοποίησε για τους κινδύνους των deepfake, υποστηρίζοντας ότι το Κρεμλίνο ετοιμαζόταν να χρησιμοποιήσει τη μέθοδο στο πλαίσιο εκστρατείας παραπληροφόρησης.

Всі ви, напевно, чули про технологію Діпфейк (англ. deepfake; поєднання слів deep learning («глибинне навчання») та fake («підробка») — методика синтезу зображення людини, яка базується на штучному інтелекті.

Готується провокація РФ.https://t.co/XYyS9WsPkK

— Defence intelligence of Ukraine (@DI_Ukraine) March 2, 2022