Οι ειδικοί της τεχνητής νοημοσύνης μάς λένε ότι ζούμε σε απρόβλεπτους καιρούς. Υπάρχουν όμως και κάποιοι που ίσως μπορούν να προβλέψουν καλύτερα από εμάς.

Η εφημερίδα «El Pais» απευθύνθηκε για βοήθεια στο Ινστιτούτο Μελετών του Μέλλοντος στη Στοκχόλμη, μια επιστημονική ομάδα που ξεκίνησε τη δεκαετία του 1960 για να οραματιστεί τα πιο πιθανά μακροπρόθεσμα σενάρια για την ανθρωπότητα.

Στο Ινστιτούτο εργάζονται 100 ερευνητές από 15 χώρες και διάφορους κλάδους – κοινωνιολόγοι, φιλόσοφοι, πολιτικοί επιστήμονες, οικονομολόγοι, μαθηματικοί. Πρόκειται για μια νησίδα ανθρωπισμού, ένα καταφύγιο για να σκεφτεί κάποιος βαρυσήμαντα ζητήματα όπως οι μελλοντικές γενιές, η κοινωνική δικαιοσύνη και οι επιπτώσεις της τεχνολογίας.

Το πρώτο ερώτημα είναι προφανές: είναι πολύ αργά για να αμφισβητήσουμε την τεχνολογία; «Οι πολίτες, οι κοινωνίες και κυρίως οι ρυθμιστικές Αρχές υστερούν πάντα σε σχέση με την τεχνολογική πρόοδο», εξηγεί ο καθηγητής Φιλοσοφίας Γκουστάφ Αρένιους.

«Ανησυχώ λιγότερο για το τι θα κάνουν οι μηχανές παρά για το τι μπορεί να κάνουν οι άνθρωποι με αυτές».

Η τεχνητή νοημοσύνη αποτελεί ήδη ένα τεράστιο αίνιγμα – πόσω μάλλον ένας μελλοντικός κόσμος με ρομπότ ικανά να εξολοθρεύσουν την ανθρωπότητα – και οι κυβερνητικές ρυθμιστικές Αρχές πασχίζουν να προλάβουν. Στις αρχές Μαΐου, η Ευρωπαϊκή Ενωση (ΕΕ) ενέκρινε την Πράξη για την Τεχνητή Νοημοσύνη, η οποία θα ρυθμίζει ορισμένες πρακτικές τεχνητής νοημοσύνης όταν τεθεί σε ισχύ το 2025.

Στην ανοιχτή επιστολή που έστειλαν 1.000 ερευνητές, επιχειρηματίες και διανοούμενοι, μεταξύ των οποίων ο Ιλον Μασκ και ο Γιουβάλ Νοά Χαράρι, ζητούν παύση της έρευνας για την τεχνητή νοημοσύνη και ρυθμίσεις για τα «απρόβλεπτα μοντέλα» πέραν του ChatGPT4.

Μπορεί, όμως, κάποιος να σταματήσει την τεχνολογική πρόοδο; «Ο κυρίαρχος λόγος τον τελευταίο χρόνο, ιδίως από την τεχνολογική κοινότητα, χαρακτηρίζεται από τεχνολογικό ντετερμινισμό – θα έρθει ό,τι κι αν γίνει. Αλλά αυτό απλά δεν είναι αλήθεια», παρατηρεί ο Καρίμ Τζεμπαρί, ένας άλλος φιλόσοφος στο Ινστιτούτο.

Περιγράφει πως αρκετές φορές στην ιστορία άλλαξαν ή σταμάτησαν την τεχνολογική ανάπτυξη – την κλωνοποίηση του ανθρώπου, τα γενετικά τροποποιημένα τρόφιμα και την πυρηνική ενέργεια.

«Οταν αρκετοί άνθρωποι πιστεύουν ότι κάτι είναι επικίνδυνο, οι πολιτικοί ενεργούν», σημειώνει. Θα πρέπει λοιπόν να σταματήσουμε την ανάπτυξη της τεχνητής νοημοσύνης; «Φυσικά, αν πιστεύουμε ότι πρέπει. Ζούμε σε μια δημοκρατία – αν ο λαός ζητήσει περιορισμούς, αυτό θα συμβεί. Ακόμη και τα αντιδημοκρατικά κράτη το κάνουν αυτό. Η Κίνα συχνά πατάει φρένο όταν αισθάνεται ότι κάτι ξεφεύγει από τον έλεγχο».

Η έκκληση για μορατόριουμ στην τεχνητή νοημοσύνη βασίζεται εν μέρει στην πεποίθηση ότι ο ανταγωνισμός του ιδιωτικού τομέα τροφοδοτεί την επικίνδυνη έρευνα και ανάπτυξη. Αποτελεί πρόβλημα το ότι η ανάπτυξη της τεχνητής νοημοσύνης βρίσκεται στα χέρια του ιδιωτικού τομέα;

«Το να έχουμε τις εταιρείες να ηγούνται της κούρσας είναι προβληματικό», παρατηρεί ο Αρένιους. «Τα κίνητρα για να παραμείνουν εντός των ηθικών ορίων θα μπορούσαν να αντισταθμιστούν από την επιδίωξη κέρδους και τον φόβο να μείνουμε πίσω από τον ανταγωνισμό».

«Τα πάντα γύρω από την τεχνητή νοημοσύνη – το χάσμα μεταξύ αισιόδοξων και δυστοπικών – είναι όλο και πιο πολωμένο», αναφέρει η κοινωνιολόγος Μόα Μπαρσέλ. Μία από τις πρόσφατες ερευνητικές της προσπάθειες επικεντρώνεται σε ένα από τα σημαντικότερα ερωτήματα σχετικά με την Τεχνητή Νοημοσύνη.

Μπορεί να βοηθήσει στην αποφυγή του ανθρώπινου λάθους και της προκατάληψης, να είναι πιο αντικειμενική και να ευθυγραμμιστεί καλύτερα με ορισμένες αξίες; Η Μπαρσέλ, που ειδικεύεται στην ένταξη και την ποικιλομορφία στην αγορά εργασίας, ισχυρίζεται ότι είναι ουδέτερη σχετικά με το πώς χρησιμοποιείται η τεχνητή νοημοσύνη στις διαδικασίες πρόσληψης εργασίας που μελετά. Θεωρητικά, πιστεύει ότι μπορεί να είναι πολύ χρήσιμη, όπως οι αλγόριθμοι που αναλαμβάνουν τη γραφειοκρατία για τα τμήματα ανθρώπινου δυναμικού, ώστε να επικεντρωθούν στην επιλογή των υποψηφίων.

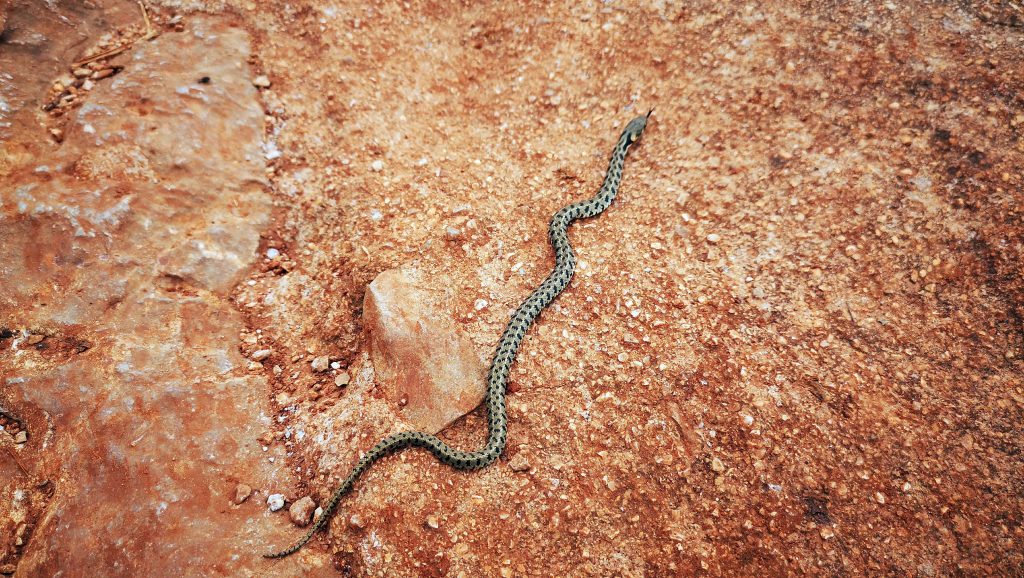

Ο πολιτικός επιστήμονας Λούντβιγ Μπέκμαν μελετά τις επιπτώσεις της τεχνητής νοημοσύνης στη δημοκρατία. Είναι ένας άλλος τομέας όπου η τεχνολογία εγείρει πολύπλοκα ερωτήματα σχετικά με τις υπερ-ευφυείς μηχανές του μέλλοντος. Θα μπορέσουν ποτέ τα ρομπότ να ψηφίσουν; «Δεν το νομίζω», απαντά, «αλλά το ερώτημα σε αναγκάζει να σκεφτείς τα όρια της ένταξης και γιατί πιστεύουμε ότι ορισμένοι άνθρωποι ή άλλοι δεν θα έπρεπε να έχουν δικαίωμα ψήφου», όπως τα παιδιά, τα άτομα με σοβαρή νοητική υστέρηση, τα ζώα… Θα μπορούσαν τότε τα ρομπότ να έχουν δικαιώματα; Και πάλι, ο Μπέκμαν έχει αμφιβολίες.

«Η τεχνολογία τεχνητής νοημοσύνης έχει στόχους, όχι συμφέροντα. Παρ’ όλα αυτά, δυσκολεύομαι να δω την ηθική βλάβη που συνεπάγεται η έλλειψη σεβασμού σε μια μηχανή».

Οι κοινωνικοί ερευνητές συμφωνούν ότι η τεχνητή νοημοσύνη είναι επαναστατική, αλλά είναι απλώς ένα εργαλείο που χρησιμοποιούμε και δεν έχει ακόμη αλλάξει ριζικά τη ζωή μας. Μπορούμε να προβλέψουμε ποιες εφαρμογές τεχνητής νοημοσύνης θα πετύχουν και ποιες θα μείνουν στο περιθώριο; «Αν μπορούμε να προβλέψουμε ποιες εφαρμογές θα γίνουν πιο δημοφιλείς, μπορούμε να εντοπίσουμε τα πιο επείγοντα ηθικά ζητήματα», παρατηρεί ο Πόντους Στρίμλινγκ, που διαπιστώνει ότι η χρηστικότητα ή η λειτουργικότητα μιας εφαρμογής δεν καθορίζει τόσο την επιτυχία της όσο ο τρόπος με τον οποίο «εξαπλώνεται».

Η πιο αποτελεσματική μέθοδος διάδοσης είναι η «έγχυση» – όταν μια καινοτομία τρυπώνει σε ένα εργαλείο που όλοι ήδη χρησιμοποιούν.

«Το Netflix, η Google και το YouTube εισήγαγαν μια μέρα την τεχνητή νοημοσύνη και τη βαθιά μάθηση στις λειτουργίες συστάσεών τους και αυτό εξαπλώθηκε αμέσως στους υπολογιστές όλου του πλανήτη χωρίς οι χρήστες να το καταλάβουν ιδιαίτερα», εξηγεί.

Και αναρωτιέται: «Πού είναι η ελευθερία επιλογής του χρήστη; Πώς εκπροσωπείται η πολιτισμική ποικιλομορφία όταν μια μικρή ομάδα ανθρώπων σε ένα πολύ συγκεκριμένο περιβάλλον – κυρίως προγραμματιστές της Silicon Valley – παίρνουν αποφάσεις χωρίς να μας συμβουλεύονται για πράγματα που όλοι θα χρησιμοποιούν καθημερινά στο μέλλον;».

Πώς θα επηρεάσει η τεχνητή νοημοσύνη τον τρόπο που εργαζόμαστε; Θα μας απαλλάξει από κουραστικές εργασίες και θα βελτιώσει την ποιότητα ζωής μας; Ή θα μας εκμεταλλεύεται ακόμη περισσότερο; «Εξαρτάται», λέει ο Τζεμπαρί.

«Πολλές εταιρείες τη χρησιμοποιούν για να αυξήσουν την παραγωγικότητα, να βελτιώσουν την ακρίβεια και να βοηθήσουν να επωμιστούν το βάρος. Το αντίθετο ισχύει για άλλες εταιρείες. Η πρόκλησή τους δεν είναι τεχνολογική, αλλά τα ρυθμιστικά, συνδικαλιστικά και πολιτικά προβλήματα γύρω από αυτήν».

Φέρνει ως παράδειγμα τις πιο ρομποτικοποιημένες αποθήκες της Amazon – ήταν μεν πιο παραγωγικές, αλλά είχαν επίσης συχνότερα ατυχήματα, περισσότερο άγχος και μεγαλύτερη εργασιακή δυσαρέσκεια, επειδή οι εργαζόμενοι έπρεπε να προσαρμοστούν στους φρενήρεις ρυθμούς των μηχανών.